هنر تدوین و موشنگرافیک وارد عصر جدیدی شده است. دیگر برای متحرکسازی یک تصویر ثابت، نیازی به ساعتها کیفریمگذاری دستی در افترافکت نیست. هوش مصنوعی Wan 2.2 با ورود به صحنه، فاصلهی میان تخیل و واقعیت را به حداقل رسانده است. این مدل که نسخهی ارتقایافتهی خانواده Wan محسوب میشود، با تمرکز بر حفظ جزئیات (High-Fidelity) و درک عمیق از فیزیک حرکت، ابزاری بیرقیب برای هنرمندان دیجیتال است. اگر به دنبال خروجیهایی هستید که از نظر نورپردازی و بافت، با دوربینهای سینمایی برابری کند، این مدل پاسخ نهایی شماست.

در صورتی که به ابزارهای هوش مصنوعی علاقهمند هستید، میتوانید با یکی از جدیدترین فناوریها در زمینه تولید ویدیو نیز آشنا شوید. برای مطالعه بیشتر، مقاله هوش مصنوعی ویدیو ساز Seedance 2.0 را از دست ندهید.

1 – چرا Wan 2.2 14B یک غول گرافیکی است؟

تعداد پارامترها در مدلهای زبانی و تصویری، مستقیماً با “هوش” و “درک” مدل رابطه دارد. مدل ۱۴ میلیارد پارامتری Wan 2.2، تعادل خیرهکنندهای میان سرعت رندر و کیفیت بصری ایجاد کرده است. استفاده از نسخههای GGUF به کاربران اجازه میدهد تا این مدل سنگین را روی سیستمهای خانگی و ورکشاپهای شخصی اجرا کنند. انتخاب سطح کوانتایز بالاتر از Q4 تضمین میکند که شما بالاترین دقت رنگی و جزئیات بافت را بدون نیاز به ابرکامپیوترها در اختیار داشته باشید.

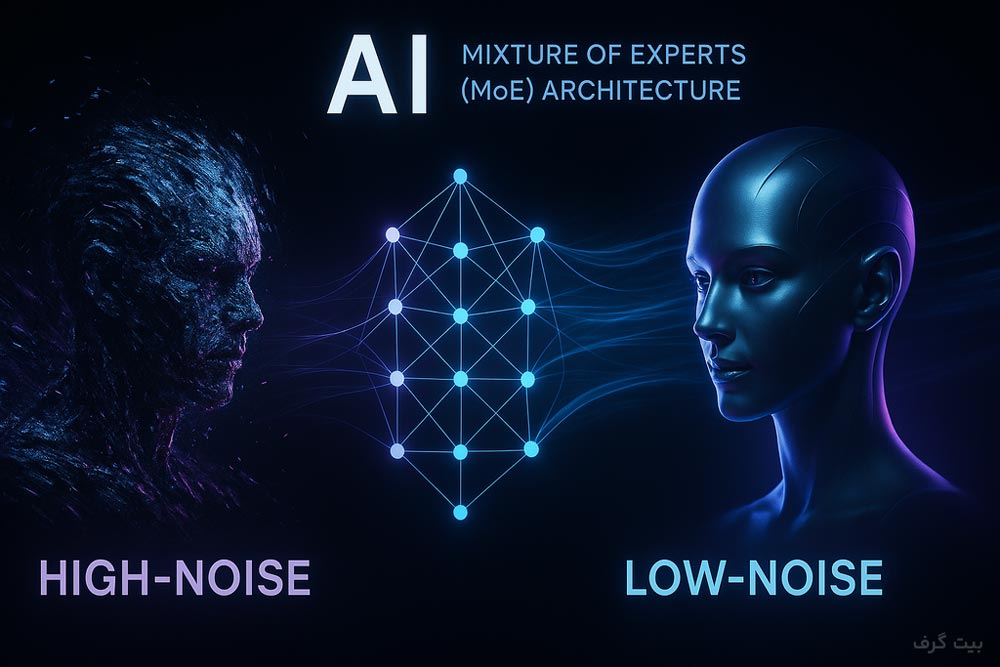

2 – معماری MoE و اهمیت دوگانه مدلهای High-Noise و Low-Noise

یکی از مفاهیم کلیدی در هوش مصنوعی Wan 2.2، استفاده از سیستم “مخلوطی از متخصصین” یا MoE است. در این فرآیند، تولید ویدیو به دو مرحلهی اساسی تقسیم میشود:

نسخه High-Noise: این مدل متخصصِ “ساختار” است. در مراحل اولیه رندر، وظیفه دارد فیزیک حرکت، ترکیببندی صحنه و جابهجایی سوژهها را بر اساس عکس ورودی پیریزی کند.

نسخه Low-Noise: این مدل متخصصِ “ظرافت” است. پس از شکلگیری ساختار، وارد عمل شده و نویزهای تصویر را به بافتهای سینمایی تبدیل میکند، لرزشهای اضافی را میگیرد و انسجام فریمها را تثبیت میکند.

برای یک تبدیل عکس به ویدیو با هوش مصنوعی موفق، استفاده همزمان از هر دو فایل ضروری است تا خروجی نهایی هم حرکت درستی داشته باشد و هم ظاهری کاملاً حرفهای.

3 – پیشنیازهای فنی و سختافزاری

اجرای مدل ۱۴ میلیاردی در محیط ComfyUI نیازمند منابع مشخصی است. با توجه به استفاده از نسخهی Q6_K و fp8، (مدل فعلی روی سرورهای بیت گرف) پیشنهاد میشود سیستمی با حداقل ۲۰ تا ۲۴ گیگابایت VRAM (مثل RTX 3090 یا 4090) در اختیار داشته باشید. علاوه بر فایلهای اصلی مدل، شما به اجزای زیر نیز نیاز دارید:

Text Encoder (T5-XXL): برای درک دقیق پرامپتهای متنی.

VAE اختصاصی: جهت دیکود کردن کدهای لاتنت به فریمهای ویدیویی با کیفیت.

CLIP Vision: برای آنالیز دقیق تصویر ورودی جهت حفظ شباهت کامل ویدیو به عکس اصلی.

4 – کاربرد در دنیای واقعی: از موشنگرافیک تا تبلیغات

استفاده از هوش مصنوعی Wan 2.2 صرفاً یک سرگرمی نیست. این ابزار به معنای سرعت بخشیدن به ساخت استوریبوردها و ویدیوهای تبلیغاتی (Commercial) با کانسپتهای انتزاعی و مینیمال است. توانایی این مدل در تولید ویدیوهای ۴۸۰p و ۷۲۰p با قابلیت ارتقا (Upscale)، آن را به یک گزینهی ایدهآل برای پستهای شبکههای اجتماعی و تیزرهای لوکس تبدیل کرده است.

جمع بندی

هوش مصنوعی Wan 2.2 نه تنها یک ابزار جدید، بلکه یک دستیار هوشمند برای هر طراح و تدوینگر است. با استفاده از تکنیک تبدیل عکس به ویدیو با هوش مصنوعی، مرزهای خلاقیت جابهجا شده است. نسخهی 14B GGUF با تنظیمات Q6_K، بهترین کیفیت ممکن را در بستر سیستمهای شخصی ارائه میدهد. با درک درست از تفاوت مدلهای نویز بالا و پایین و چیدمان صحیح نودها در ComfyUI، میتوانید ویدیوهایی خلق کنید که تا پیش از این تولید آنها هفتهها زمان میبرد. آیندهی ویدیو اکنون در دستان شماست.

راهنمای استفاده:

هر دو نسخه high_noise و low_noise را دانلود کرده و در مسیر زیر قرار دهید: ComfyUI\models\diffusion_models

لطفا ورک فلو هم بگذارید . سپاسگذارم

عالیه. ممنون از شما. به خوبی کار می کنه. خیلی به من کمک کرد.

اگر براتون مقدور بود، مدل های جدیدتر wan رو قرار بدید.

خواهش میکنم. تلاش میکنیم.

درود عزیزان.

اول اینکه مرسی که اینقدر زحمت میکشید. تستتون طلا.

دو اینکه لطفا comfyUI رو برای لینوکس (rocky مثلا) قرار میدین؟

سه اینکه امکانش هست qwen3.6 ورژن dense رو هم بذارید؟ (qwen3.6 27B q_4_k_m کوانتیزه ۴ هر ورژنیش که سالمه و صلاح میدونین)

در مقاله مربوط به qwen 3.6 مدل Qwen3.6-27B-Uncensored-HauhauCS-Aggressive-Q4_K_P قرار گرفت.